MNN Chat是基于MNNLLM的手机大模型应用,能在手机端独立运行多种大型模型。有多模态功能,CPU推理性能提升,模型兼容广,本地化运行,体积小巧,支持离线工作,还具备多种优势,兼容多种格式与系统。

MNN Chat(手机大模型应用)特色

1. 多模态功能丰富:涵盖文本到文本、图像到文本、音频转文本以及文本生成图像等多种应用场景。

2. CPU推理性能出色:在安卓平台上,MNN-LLM展现出显著的CPU优化效果,预填充速度相比llama.cpp提升了8.6倍,解码速度也加快了2.3倍。

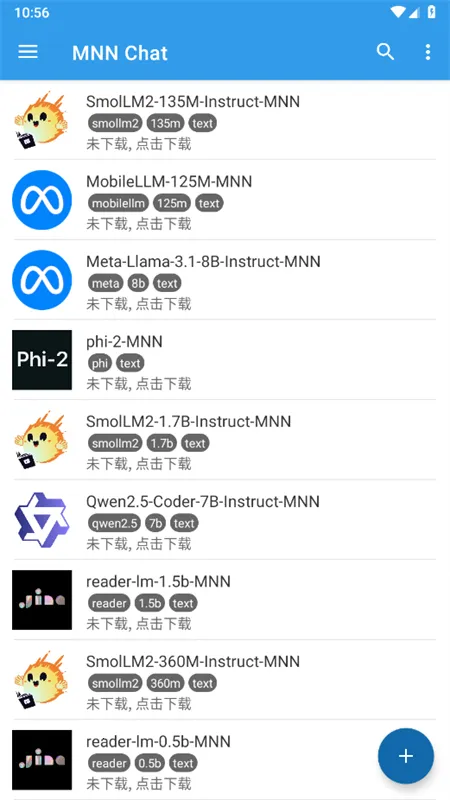

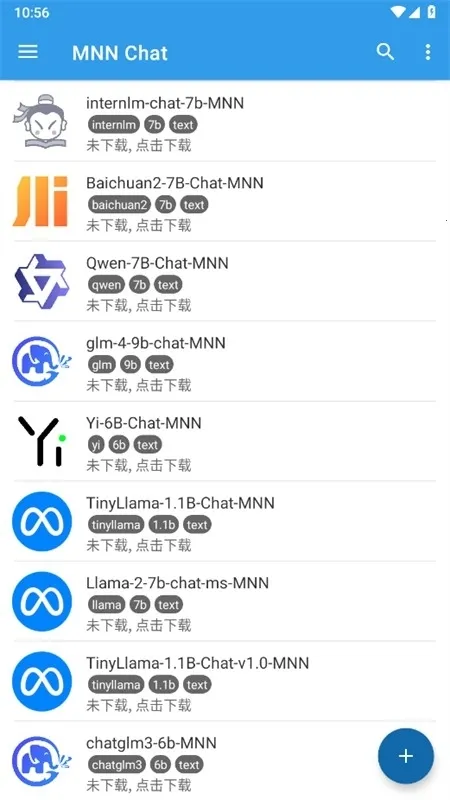

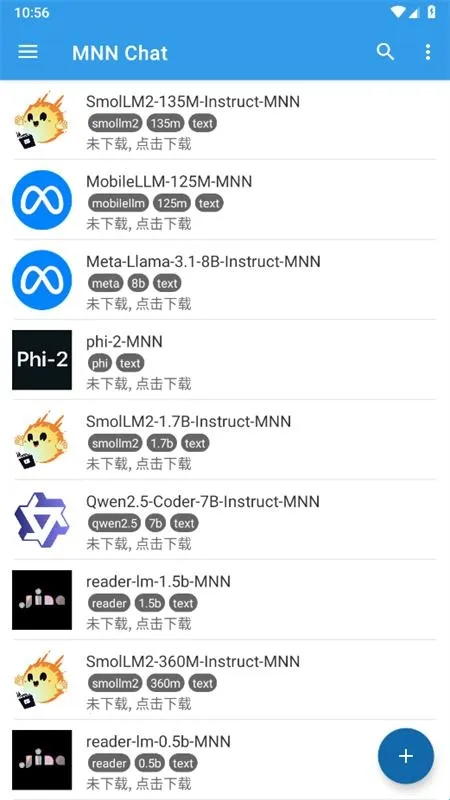

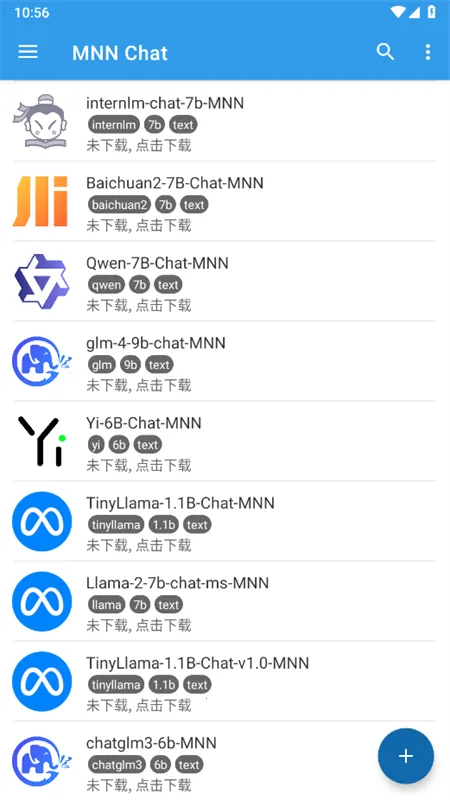

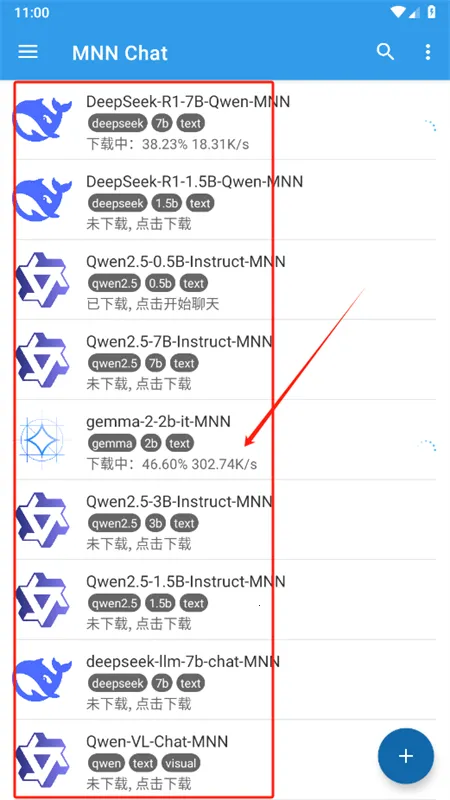

3. 模型兼容范围广:支持众多知名模型提供商,如Qwen、Gemma、Llama(含TinyLlama与MobileLLM)、Baichuan、Yi、DeepSeek、InternLM、Phi、ReaderLM及Smolm等。

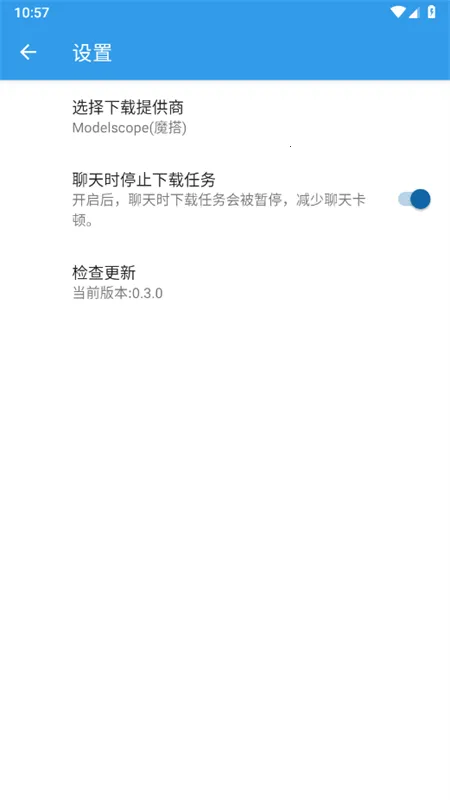

4. 保障隐私安全:本地化运行,所有操作均在设备本地执行,无需上传至外部服务器,保障数据隐私安全。

MNN Chat(手机大模型应用)优势

1. 安全纯净有保障,所有应用、游戏均经过 “病毒查杀 + 恶意代码检测” 双重核验,剔除捆绑插件、强制广告及冗余弹窗,仅保留核心功能模块,避免资源对设备安全与使用体验造成干扰。

2. 支持Mini编辑选项,可进一步缩减包体积,相较于基础库大小,约能减少25%。

3. 具备模型压缩与量化功能,支持FP16、Int8格式,可有效降低模型体积,减少幅度可达50%至75%。

4. 核心功能即模型推理,支持CPU、GPU实现独立无依赖,代码结构精简,非常适合部署至移动设备及各类嵌入式系统。

MNN Chat(手机大模型应用)评价

这款应用有诸多亮点。它能在手机端独立运行多种大型模型,不同机型有不同选择,下载安装便捷。其多模态功能丰富,涵盖多种应用场景。在安卓平台,CPU推理性能大幅提升,预填充速度相比llama.cpp提升8.6倍,解码速度加快2.3倍。模型兼容范围广泛,支持众多知名模型提供商。本地化运行保障了数据隐私安全,操作均在本地执行。体积小巧轻便,APK安装包核心引擎仅约800KB,节省存储空间。离线工作模式无需网络,节省流量又保护隐私。并且它在核心功能、平台适配、算子库等方面也表现出色,兼容多种主流模型文件格式和网络架构,适用于多种设备和操作系统,是一款值得关注的手机大模型应用。

MNN Chat怎么用?MNN Chat使用教程

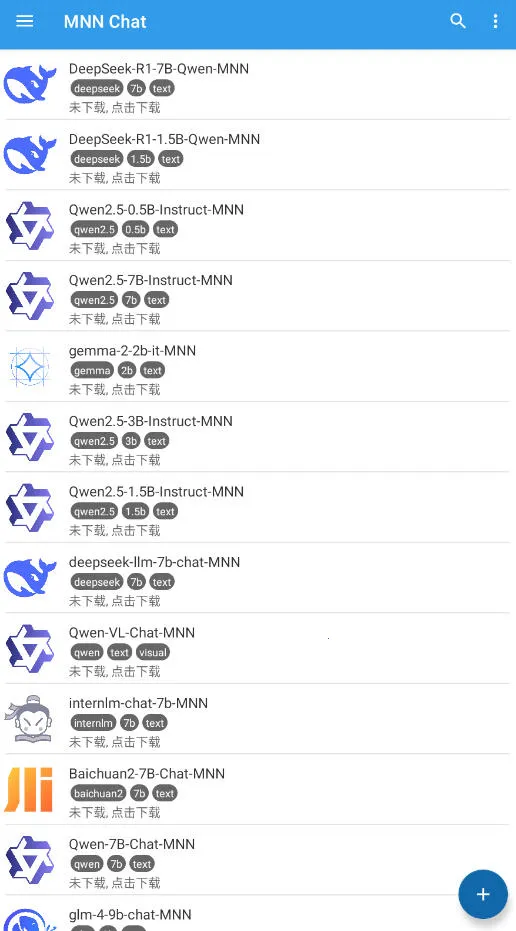

1、在宝贝游戏网下载安装软件,打开后进入主页

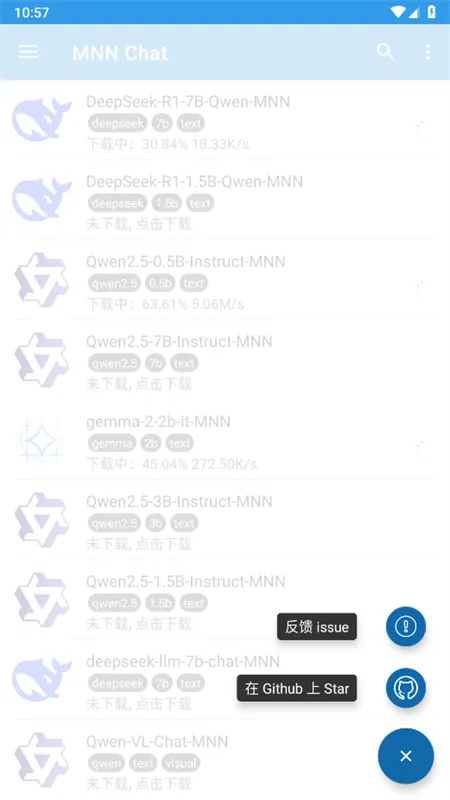

2、进入主页可以看到AI模型,大家可以根据自己的需求选择想要部署的AI模型

3、然后选择需要下载的文件,直接点击就能快速下载

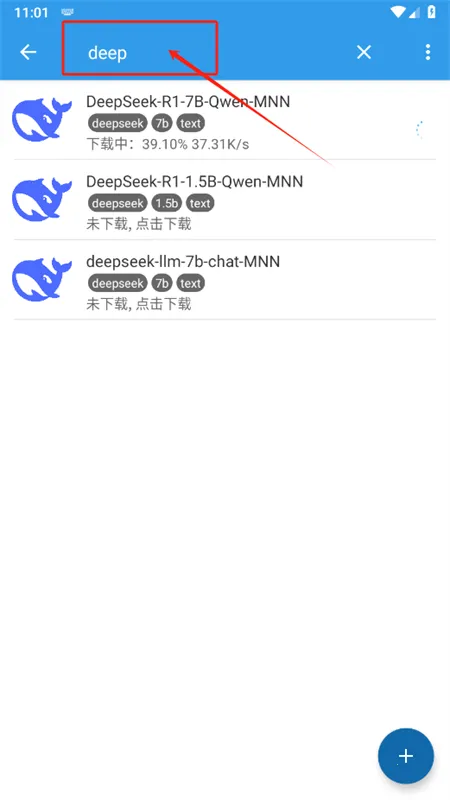

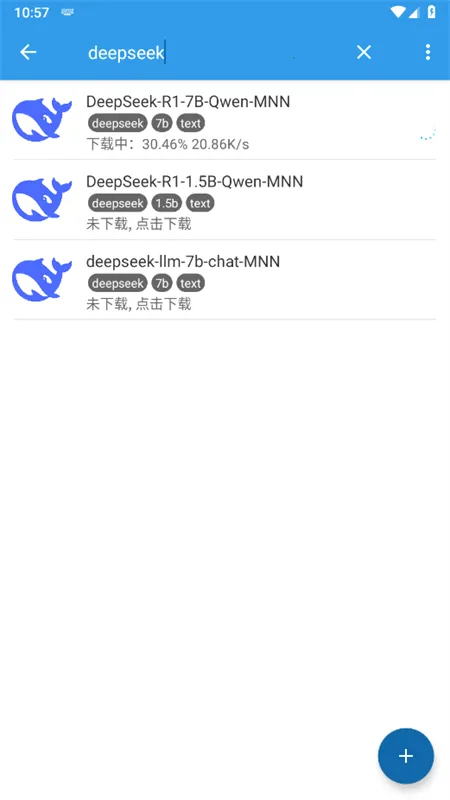

4、还可以在搜索框输入关键词进行搜索下载